以下是您提供的论文摘要的翻译:

**摘要**

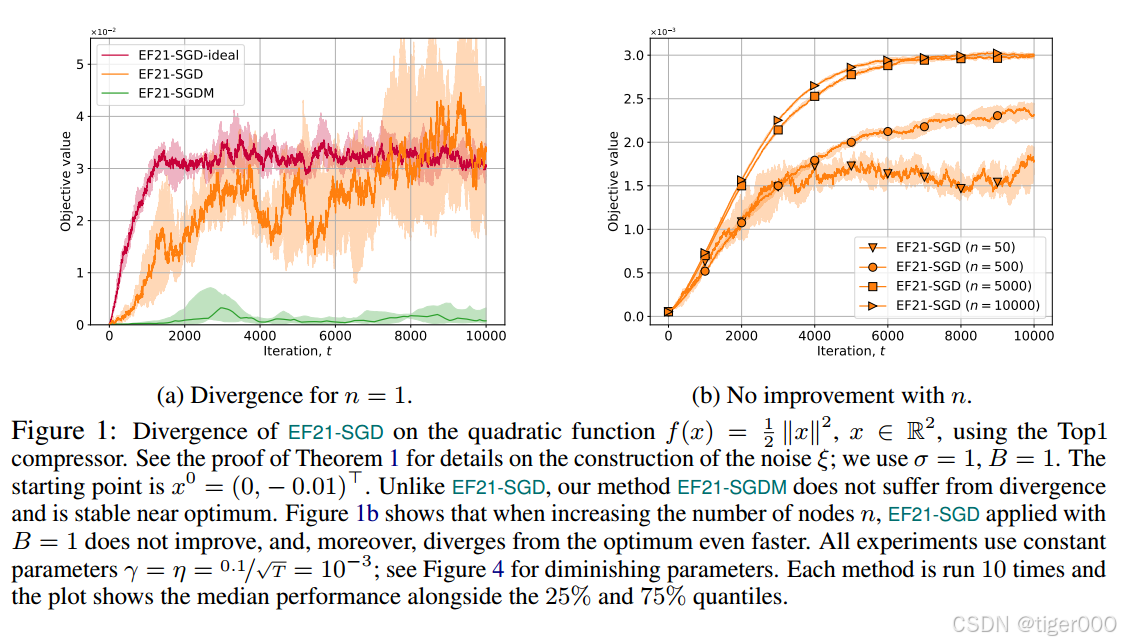

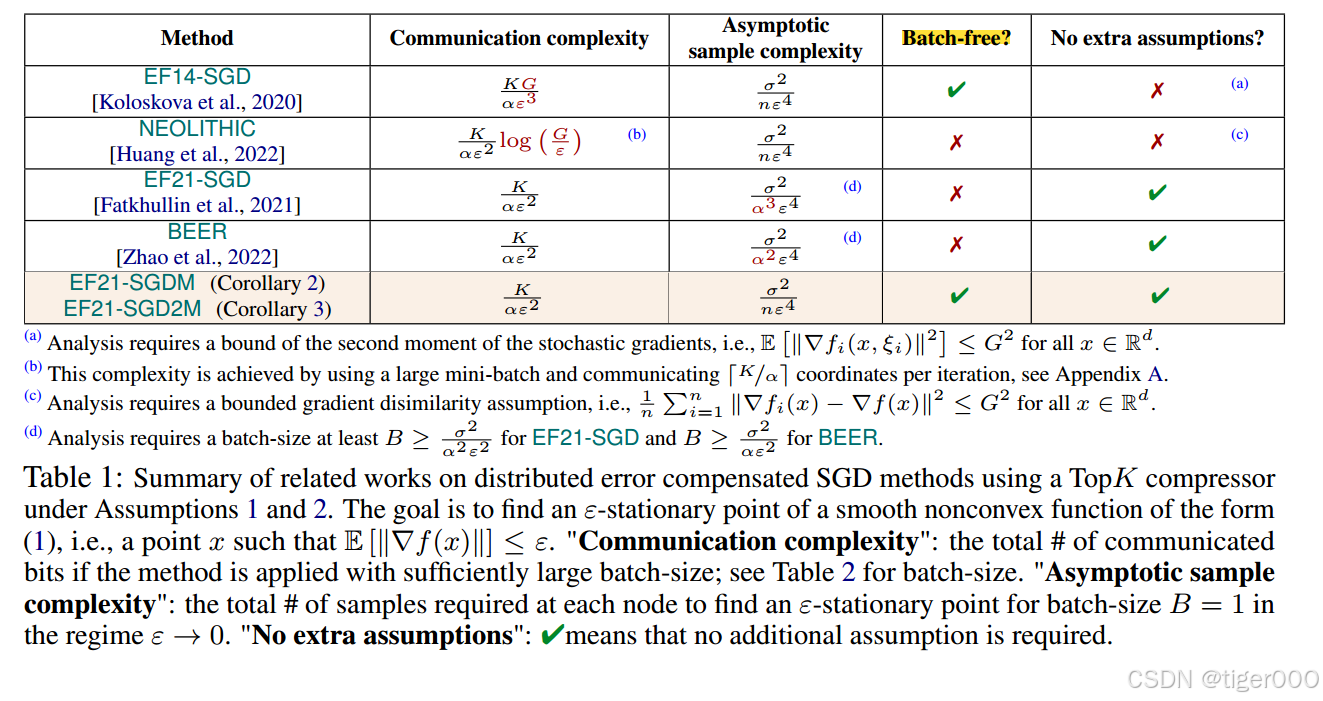

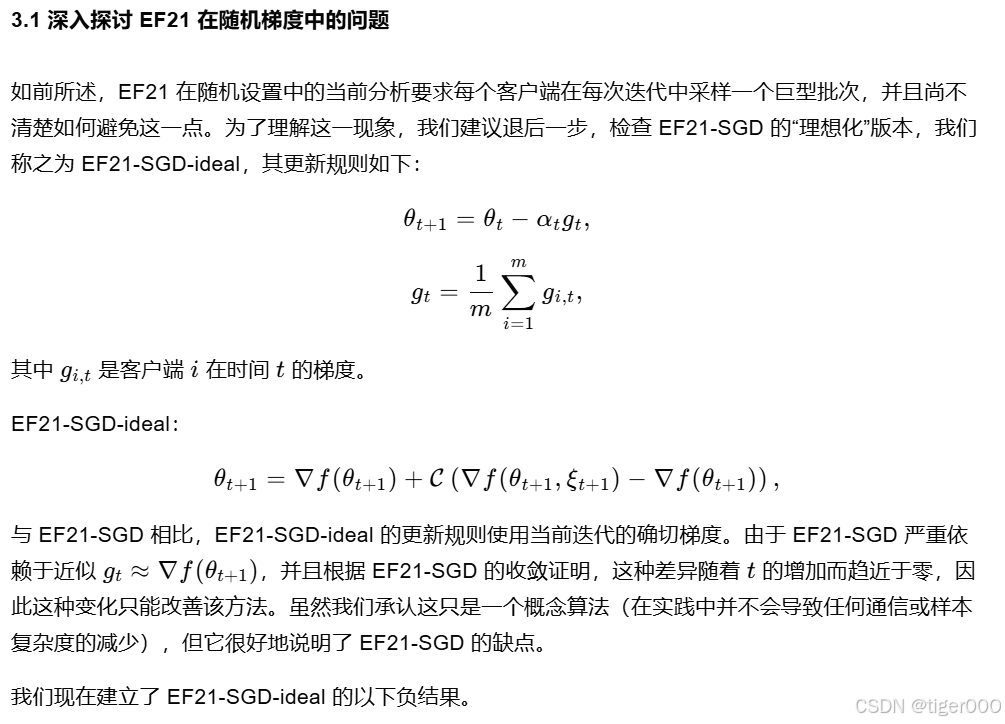

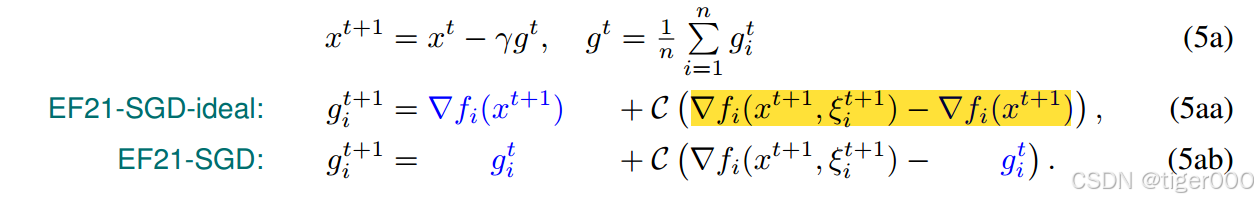

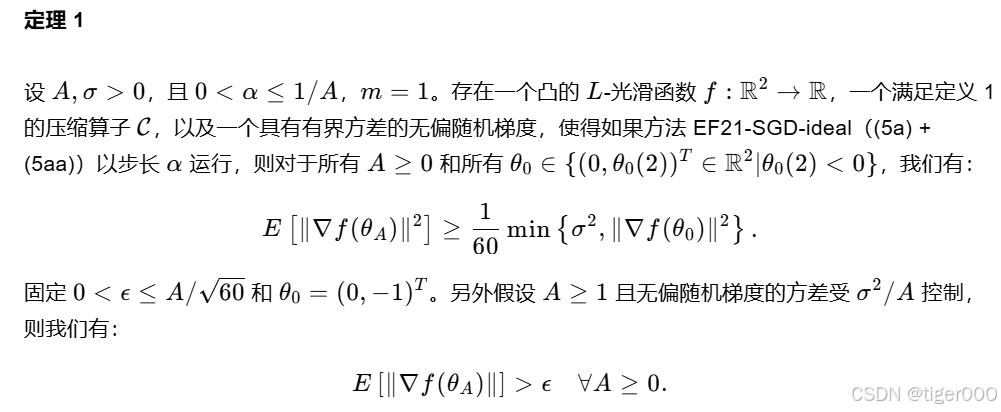

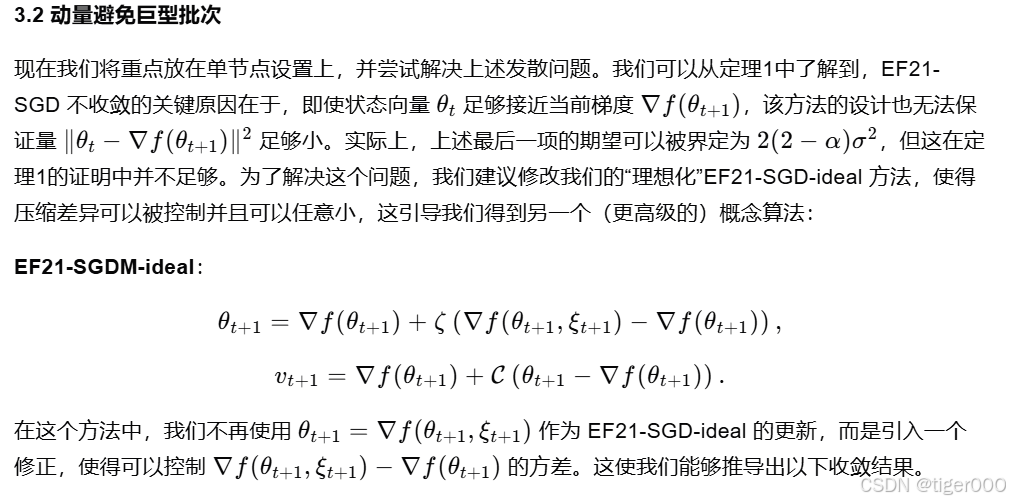

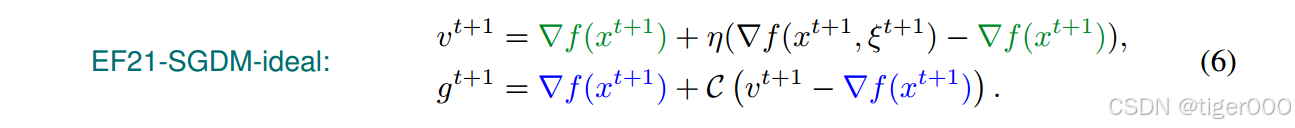

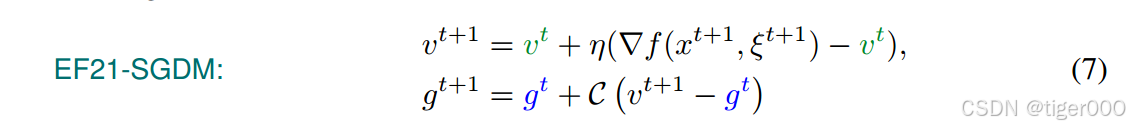

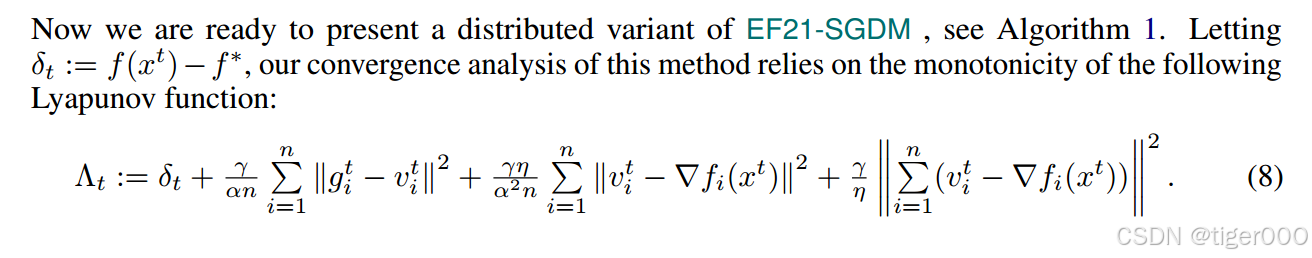

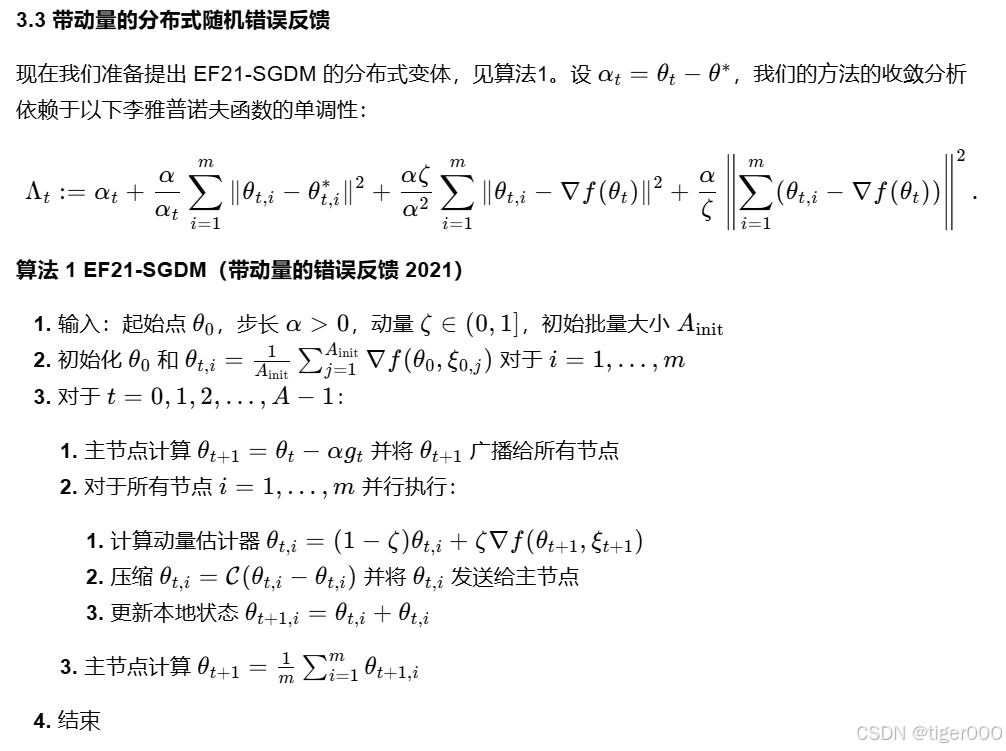

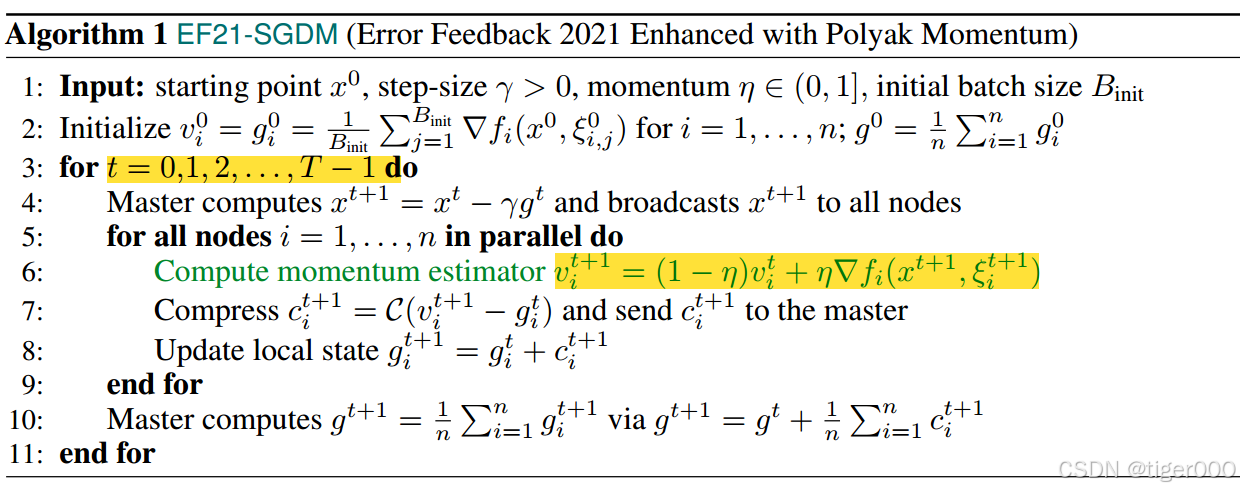

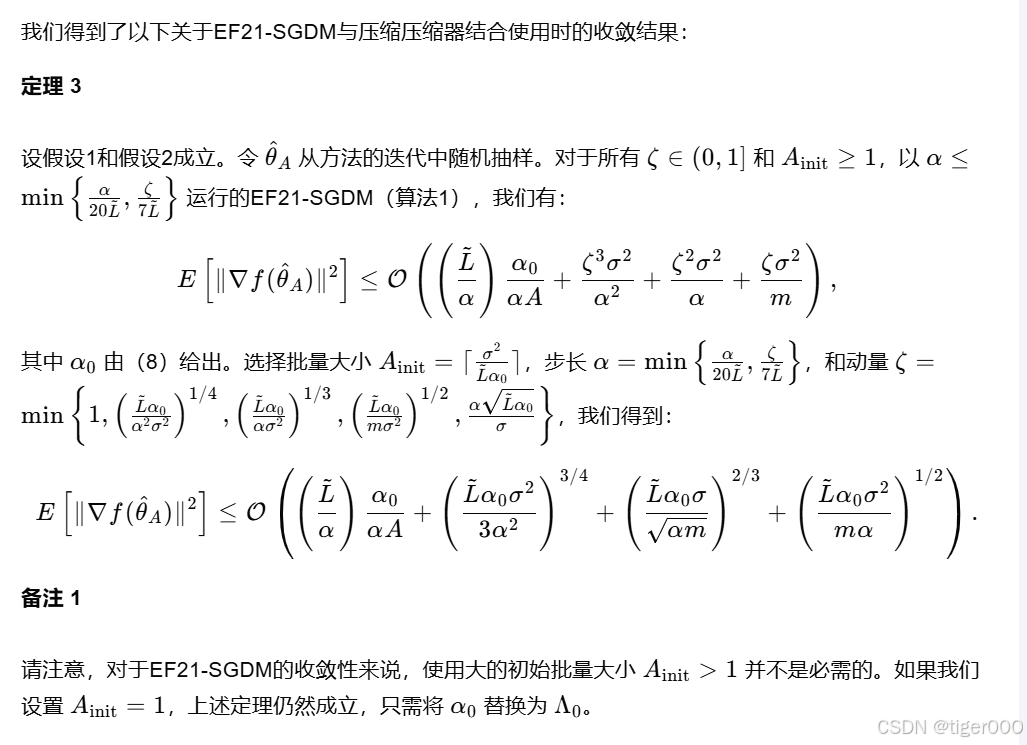

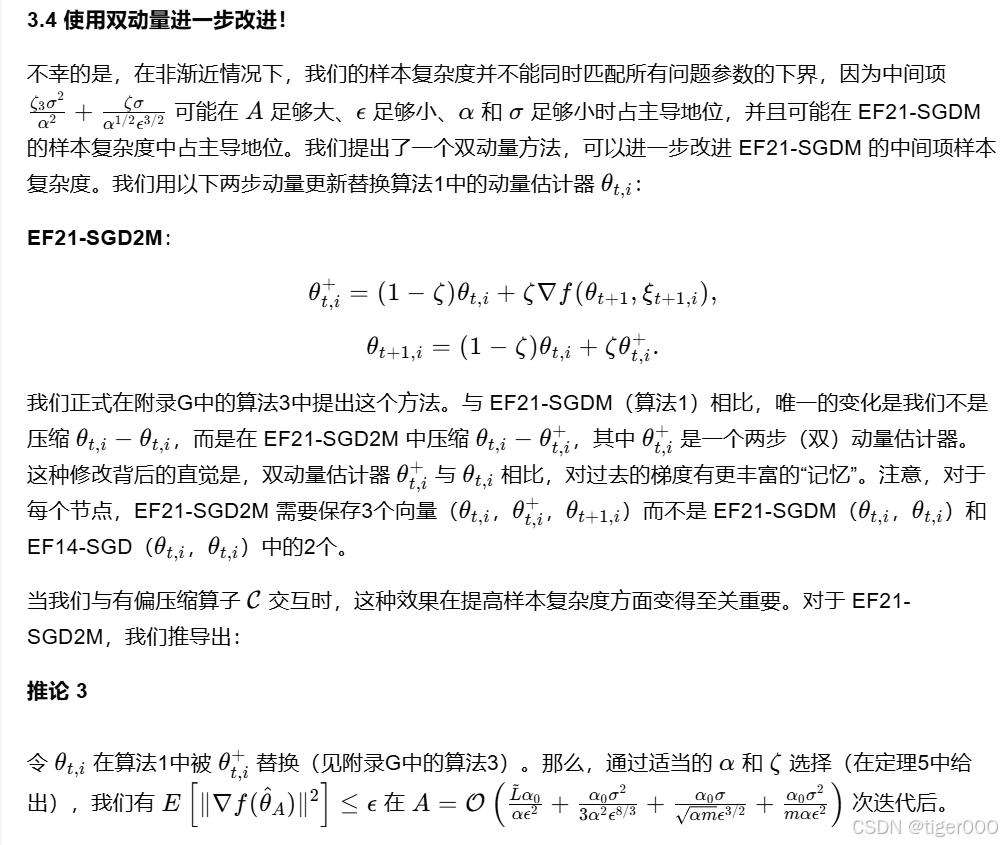

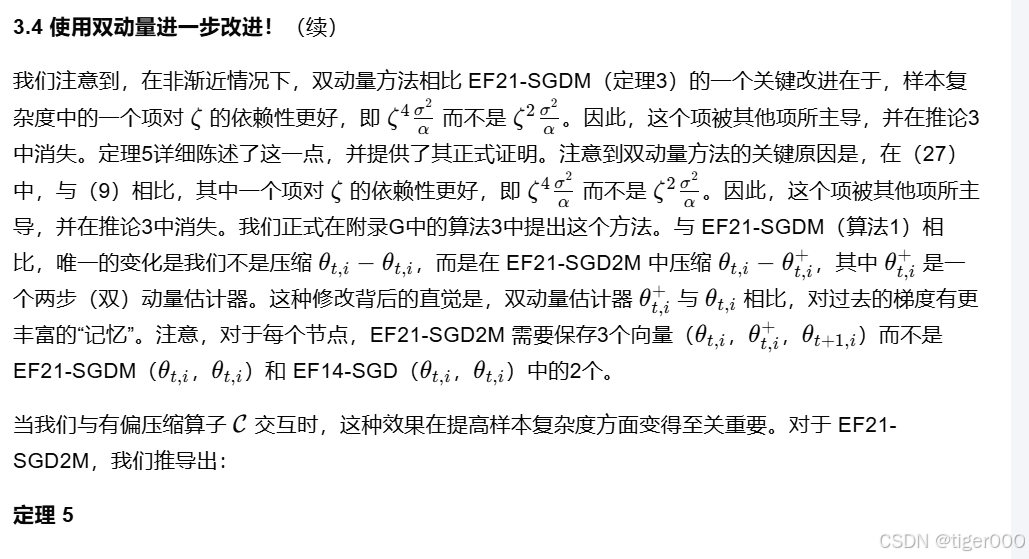

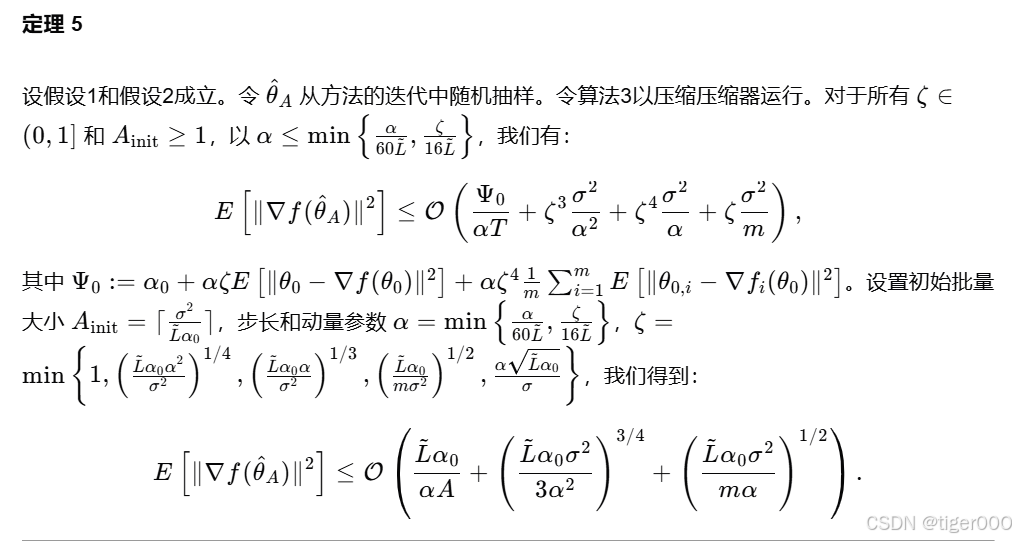

由于在分布式环境中训练机器学习模型时通信开销较高,现代算法不可避免地依赖于有损通信压缩。然而,如果不加以处理,压缩造成的错误会传播,并可能导致严重的不稳定行为,包括指数发散。近十年前,Seide等人(2014年)提出了一种错误反馈(EF)机制,我们称之为EF14,作为缓解这一问题的极为有效的启发式方法。然而,尽管在过去十年中EF领域在算法和理论方面取得了稳步进展,但我们的理解仍然远未完整。在本工作中,我们解决了一个最紧迫的问题。特别是在经典的非凸设置中,所有已知的EF变体都依赖于非常大的批量大小才能收敛,这在实践中可能是不可行的。我们提出了一个令人惊讶的简单修复,理论上和实践中都消除了这个问题:将波利亚克(Polyak)的动量应用于Richtárik等人(2021年)提出的EF最新版本,称为EF21。我们命名为EF21-SGDM的算法在标准光滑性和有界方差假设下改善了先前错误反馈算法的通信和样本复杂度,并且不需要任何进一步的强假设,如有界梯度相似性。此外,我们提出了一种双动量版本的方法,进一步改善了复杂度。我们的证明似乎是新颖的,即使在去除压缩的情况下,该证明技术在非凸随机优化中结合波利亚克动量的研究中具有独立的兴趣。